윈디하나의 블로그

윈디하나의 누리사랑방. 이런 저런 얘기

4 개 검색됨 : 2025/01 에 대한 결과

- 글쓴시간

- 분류 기술,IT

DeepSeek R1는 중국의 DeepSeek 에서 개발한 LLM 모델입니다. 쉽게 말하면 ChatGPT 같이 사용할 수 있는 AI 라고 생각하면 됩니다. 요즘에 주목받는 AI인데요, 그 이유중 하나가 성능이 좋고 무었보다 오픈소스이기 때문입니다.

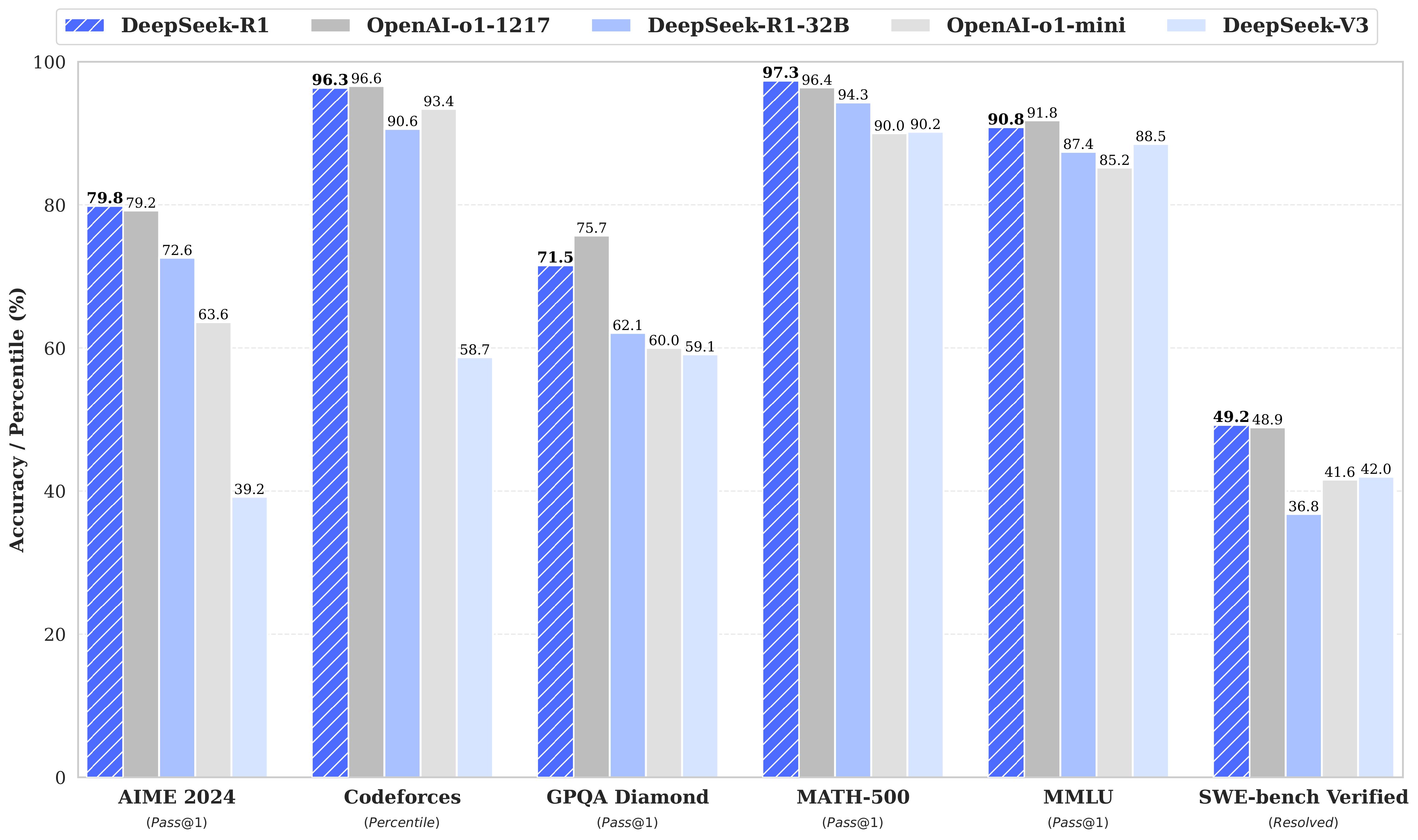

성능이 좋다는건 사용자가 원하는 답을 잘 내어준다는 의미입니다. 들리는 말에 의하면 OpenAI 의 ChatGPT o1 보다 더 좋다는 말이 있네요.

DeepSeek R1 벤치마크.

하지만 저에게 무었보다 좋은건 오픈소스라는 점 때문입니다. 이정도 성능의 모델을 오픈 소스로 풀 거라고는 생각 못했습니다. 오픈 소스로 풀린다고 해서, 당장 제가 가진 PC에서 돌려보거나 할 수는 없겠습니다만, 일단 오픈소스라는게 가장 좋아보이네요. 몇몇 사용기가 올라온걸 보면 꽤 괜찮다는것 같습니다. AI 에서 중요한 것 중 하나가 개방성인데, 거대 LLM 을 오픈하는건 중국이 미국보다 먼저 했네요.

비용이 많이 들어가는 RLHF(Reinforcement Learning from Human Feedback, 인간의 피드백에 의한 강화 학습), SFT(Supervisor Fine Tuning, 감독자에 의한 파인 튜닝)을 사용하지 않고, RL(Reinforcement Learning, 강화 학습) 만을 사용했다고 합니다. 그래서 비용이 줄었다고 하네요. 이게 대단한게 RL 만으로는 한계가 있어서 RLHF, SFT 를 사용했던건데, 다시 RL 만으로도 된다는걸 보여주는 거라고 합니다. 물론 RL 만으로 학습한게 티가 난다고 합니다만, 어느 정도일지는 사용자마다 다르겠죠. 어쨋던 대단하긴 합니다.

또한 MOE(Mixture of Experts, 전문가 혼합) 기법을 사용해 특정 주제에 맞는 부분만 활성화 시켜 연산시키기 때문에 훈련과 추론시 사용하는 메모리를 줄였고, MLA(Multi-head Latent Attention) 를 사용해 키-값을 처리해 메모리를 더 줄였습니다. 마지막으로 nVidia CUDA에서 사용하는 PTX(Parallel Thread xecution)를 적극적으로 사용해서 성능을 향상시켰습니다. PTX 는 일종의 하드웨어 독립적인 언어로, CUDA 보다도 더 저수준의 언어입니다. PTX 는 일종의 GPU용 어셈블러이긴 하지만 하드웨어 독립적입니다. (하드웨어 독립적이긴 하지만 nVidia 제품에만 사용됩니다. nVidia GPU 아키텍처에 독립적이라는 의미입니다. CUDA/PTX 를 사사용해 작성한 코드는 바이너리 코드로 변환되어 실행되는데 이 바이너리 코드를 SASS(Source and Assembly)라고 부릅니다. SASS 가 GPU에 의존적입니다) PTX 를 사용한다는게 굉장히 어려운 일이기 때문에 CUDA 정도만 사용했었는데, 중국에서는 이걸 했나보네요.

또한, 아직 추정이긴 합니다만, Distilled(추출기법)도 사용했을거라고도 생각합니다. 학습된 모델의 추론 결과를 학습할 모델의 입력으로 사용하는걸 말합니다. 쉽게 말하면 ChatGPT 의 결과를 DeepSeek 의 입력으로 사용했다는 겁니다. (이런 방식은 ChatGPT 이용 약관 위반입니다) 기사를 보면 OpenAI 에서는 어느 정도 증거를 가지고 있는것 같이 보입니다.

중국에 대한 수출 제한으로 nVidia H100 을 사용하지 못하는 제약때문에 nVidia H800 (H100 의 중국 수출 판)을 사용할 수 밖에 없었는데, H800 이 가진 한계(칩 간 전송 데이터 폭이 H100 의 절반, FP64 성능은 많이 떨어지나 FP32, TP32, BF16, FP16 의 연산은 성능이 동일함)를 극복한걸로 보이네요. H800 이 H100 에 비해 그렇게 떨어지는것도 아니긴 하구요.

nVidia H100

사용하는 방법에는 여러가지가 있겠습니다만 제가 본건 nVidia 에서 배포한 TensorRT-LLM - Deepseek-v3 사용 방법입니다. 여기에서는 BF16을 사용할 걸 추천하는데, 이경우 GPU 메모리가 1.3TB 이상 되어야 합니다. 모델 파일만 650GB 정도 되어보이고 모델 파일은 FP8 으로 되어있는것 같네요. 게다가 현재는 Hopper 아키텍처에서만 작동한다고 합니다

생성형 AI 를 사용하는 때에도, 중국 아니면 일본, 미국에서 만든 LoRA 가 많이 올라옵니다. 중국이 특히 많구요, 우리나라도 제법 있긴 합니다만, 다수라고 보기엔 무리가 있습니다. 그나마 오노마에이아이 (Onoma.AI) 에서 만든 Illustrious XL(ILXL) 과, ILXL 기반으로 만든 NoobAI-XL 이 생성형 AI 에서는 제법 알아준다고나 할까요. 우리나라도 어서 LLM 이 공개되었으면 하네요. 누가 공개할지는 모르겠습니다만 말이죠.

로컬에서 실행하는 방법: DeepSeek R1 로컬에서 실행

- 글쓴시간

- 분류 기술,IT

이번 CES 에서 nVidia 가 GeForce 50 시리즈를 발표했습니다. 코드명 블랙웰입니다. 우선 GeForce RTX 5080 이 먼저 나오고 이후에 다른 GPU 들도 순차적으로 나올 예정입니다.

- 가장 눈에 띄이는건 DLSS4 와 DLAA Multi Frame Generation 라는 신기술의 도입입니다. 응답속도를 줄이고, 프레임 보간을 4배로 해줍니다. 게임에서 초당 프레임이 60 fps 이 나온다면 DLSS4 와 Multi Frame Generation 를 사용해서 240 fps 까지 프레임 레이트를 올릴 수 있다는 거죠.

- 가격은 5090만 400달러 올라 1999 달러이고, 다른 제품은 동결입니다.

- 이번 부터 FP6 과 FP4 를 지원합니다.

- DLSS를 사용하지 않은 성능은 기존 동급의 기기와 거의 비슷할 거라고 합니다. 일단 스펙이 같고, 일부 스펙은 오히려 줄었습니다. 캐시가 늘긴 했지만 근본적으로 바뀐게 아니기 때문에 성능은 큰 향상은 없을걸로 생각합니다. 하지만 DLSS4 와 향상된 DLAA 를 게임에서 사용하면, 5070 은 4090 급의 성능을 내어줄거라고 하네요.

- 메모리는 조금 아쉽네요. 5090 에만 32GB 를 넣어주었습니다. 4090 은 24GB 이었으니 늘긴 했지만 다른 제품군에서는 전혀 늘지 않았네요. 이부분은 조금 아쉽습니다. 그래도 5090 에 32GB 를 넣어주는 바람에, RTX 5000 Ada Generation 의 가격이 떨어질걸로 예상합니다. 5090이 32GB 으로 나오면 이걸 살꺼라서요. 반대로 메모리를 많이 넣어주면 게임용이 아니라 AI용이 되기 때문에 가격이 오릅니다. 모 국가에서 대량으로 구매할거라서요. 여태까지 그래왔죠. 소비자가 실제 구매할 수 있는 가격이 어떻게 될지는 두고봐야할거 같네요.

지금 4060Ti 16GB 를 쓰고 있고 이후에는 24GB 아니면 32GB 메모리를 써야 한다고 생각하지만, 5090은 너무 비싸서 못 삽니다. 조금 기다리는거 외에는 방법이 없네요. 한 6개월 후, 그러니까 올 가을 쯤에는 5060을 볼 수 있으려나요.

- 글쓴시간

- 분류 기술,IT/하드웨어 정보

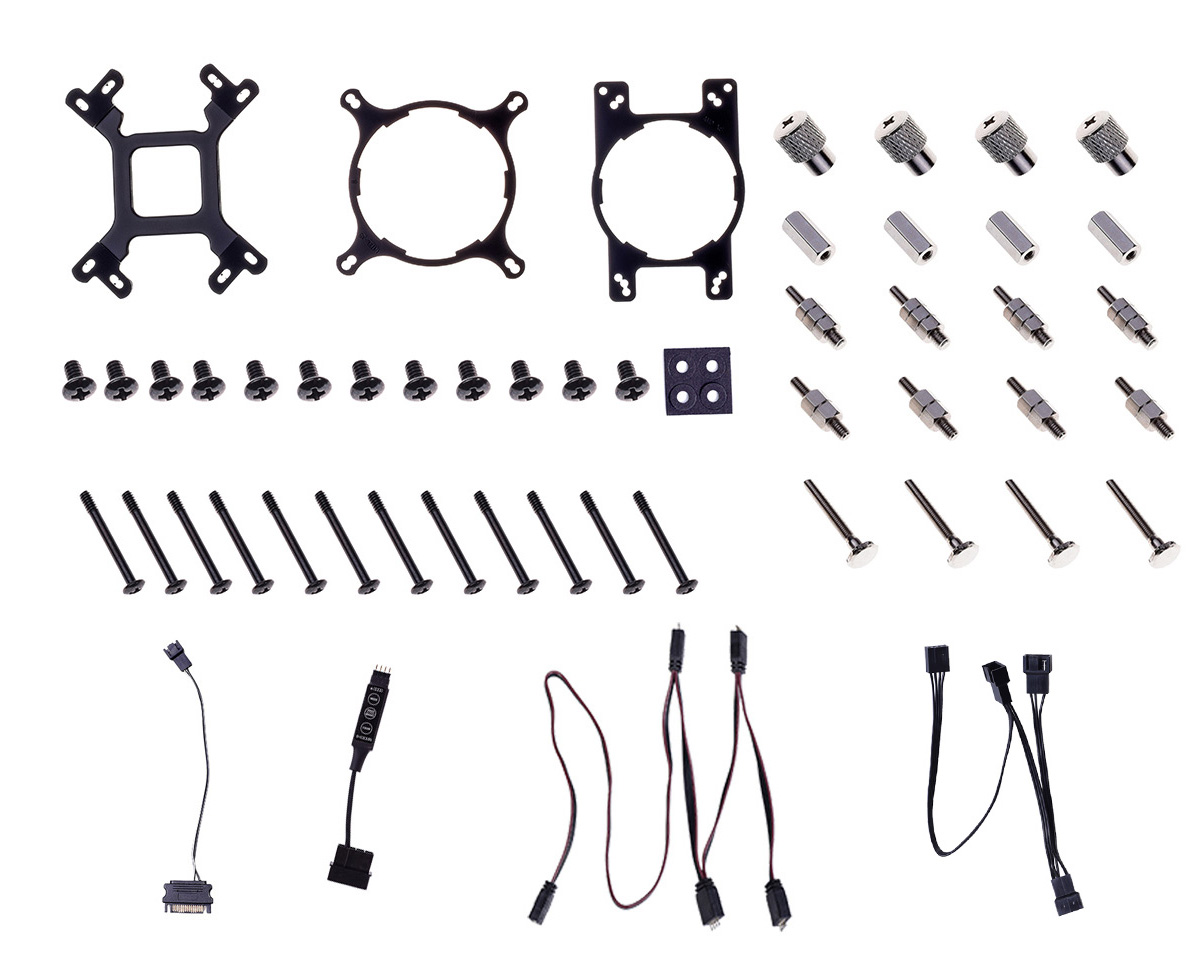

당근에서 저렴하게 팔길래 구매한 수랭 쿨러. 3열 수랭이다. 2019년 3월에 출시했다. 출시가는 12만원 중반대.

5년이 넘은 제품이라 쿨링이 잘 안될것 같기도 했는데, 역시나, 일단 받아보고 쿨러를 재조립했다. 뭔가 막혀있었던 셈. 이후에는 문제 없이 사용중이다.

쿨러가 상당히 좋은 거다. 12V RGB 도 지원한다. (ARGB 가 아니다)

3열이라 기존에 사용하던 1열 수냉 쿨러보다 CPU 온도가 떨어질 줄 알았는데 그건 아니다. 그냥 팬이 더 천천히 돌기 때문에 조용한 정도. 하지만 팬도 5년전의 팬이라 요즘 나오는 고성능 팬에 못 미치는 성능이다. 그래도, 구매 가격 생각하면 매우 만족하면서 쓰고 있다. 처음엔 RGB 팬 3개만 얻어도 본전이라고 생각한 가격이었으니 말이다.

스펙

Compatibility Intel LGA2066/2011/1700/1200/1151/1150/1155/1156

AMD AM5/AM4

TDP 350W

Radiator Dimension 397×120×27mm

Radiator Material Aluminum

Tube Material Premium Sleeved Tubing

Tube Length 465mm

Waterblock Dimension 72x72x47.3mm

Cold Plate Material Copper

Pump Current 0.36A

Rated Voltage 12V DC

Current 0.36A

Rated Power 4.32W

Pump Lift Range 1.3m H2O

Maximun Waterflow 106L/H

Pump Speed 2100±10%RPM

Pump Bearing Ceramic Bearing

Pump Life Expectancy 50,000 Hrs

Pump Noise Level 25dB(A)

Fan Dimension 120×120×25mm

Fan Speed 700~1800±10%RPM

Max. Air Flow 74.5CFM

Max. Static Pressure 2.15mmH2O

Noise 18 ~ 35.2dB(A)

Rated Voltage 12VDC

Operating Voltage 10.8~13.2VDC

Started Voltage 7VDC

Rated Current 0.2A

Power Input 2.4W

Bearing Type Hydraulic Bearing

Connector 4Pin PWM / 12V 4Pin RGB

https://prod.danawa.com/info/?pcode=7494676

https://www.idcooling.com/product/detail?id=153&name=AURAFLOW%20X%20360

----

2025.04.19

CPU 부하시 온도가 80도를 넘어 다시 한번 펌프 부위를 분해해봤다. 역시나 끈적해보이는 젤리같은게 (실제로 끈적하지는 않다) 잔뜩 끼어있었다. 이물질들을 제거하고 다시 조립하니 CPU 부하시에도 온도가 60도 정도로 정상상태로 되었다. 지난 1월 초에 했을때 이물질을 다 제거하지 않았긴 한데, 그래도 생각보다는 많았다. 올 여름은 이거로 지내고 가을 무렵에 다시 한번 열어봐야겠다.

----

2025.05.24

온도가 높아져 다시 분해해 봤다. 끈적이지는 않지만 뭔가 딱딱한 부스러기 같은게 끼어 있었다. 펌프를 막지는 않은것 같지만, 그래도 CPU 온도가 높아진거기 때문에 모두 제거했다. 펌프도 꽤 뜨거웠기 때문에 조금 기다려서 식힌다음에 분해했다.

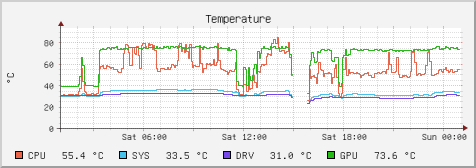

온도 그래프를 보면, 15시쯤에 수리를 시작했고 약 한시간 정도 걸렸다. 빨간색이 CPU 온도인데 평균온도가 80을 넘으면 실제 코어 온도는 100도가 넘는다는 거고 이렇게 되면 쓰로틀링이 걸린다. 수리후에는 온도가 60도 이하로 내려갔다. 수리 전보다 훨씬 더 낮아진 느낌.

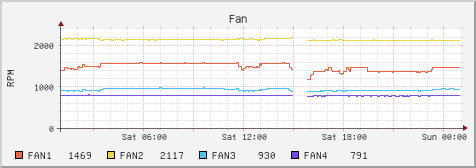

같은시점의 팬 RPM 그래프다. 특이사항 없다.

ID-COOLING ICEKIMO 120

- 글쓴시간

- 분류 이야기

올해에는 해돋이를 보러 가지는 못하고 해서, 그림으로 대신한다. 2024년 만큼 우리나라에 다사다난했던 해도 없었던것 같다. 하지만 2025년에는 이 모든게 잘 해결되리라고 믿는다.

해를 바라보기만 하기 보다는 해를 향해 다가가는 모습이 더 어울는 한해가 되길.