- 글쓴시간

- 분류 기술,IT

GB200 의 이야기는 많은데 구체적으로 어떤건지는 잘 몰라서 찾아봤습니다. GB200이 칩을 이야기하는게 아닌거 같아서 찾아본겁니다.

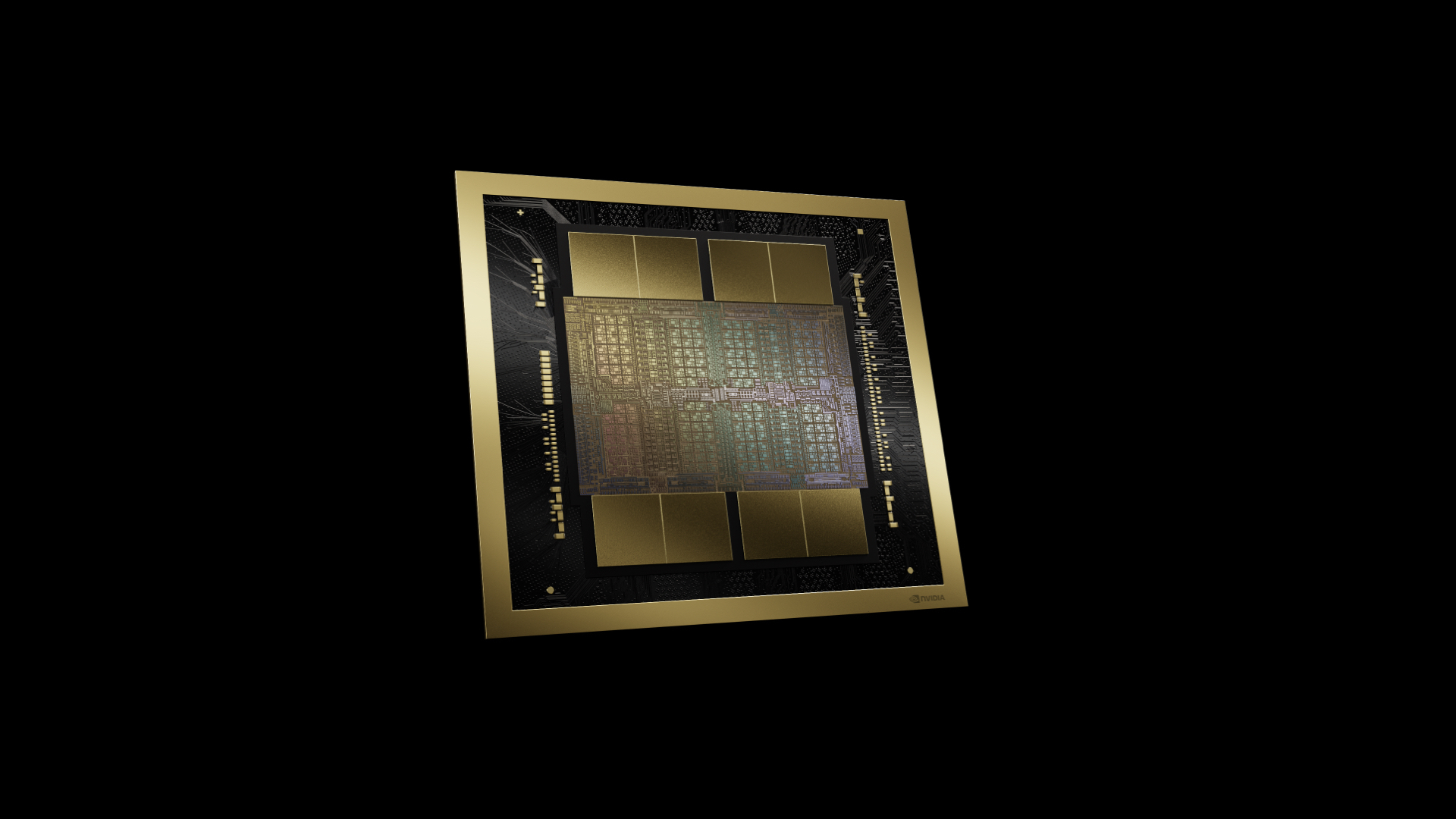

B200 은 nVidia 의 최신 GPU 칩의 모델 이름입니다. 이 칩의 코드명이 Blackwell 입니다.

nVidia B200

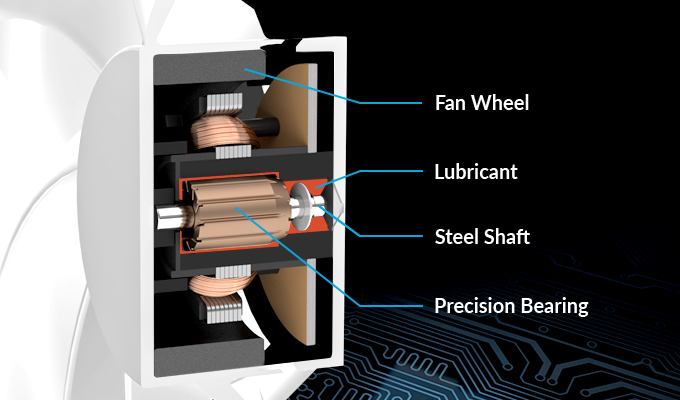

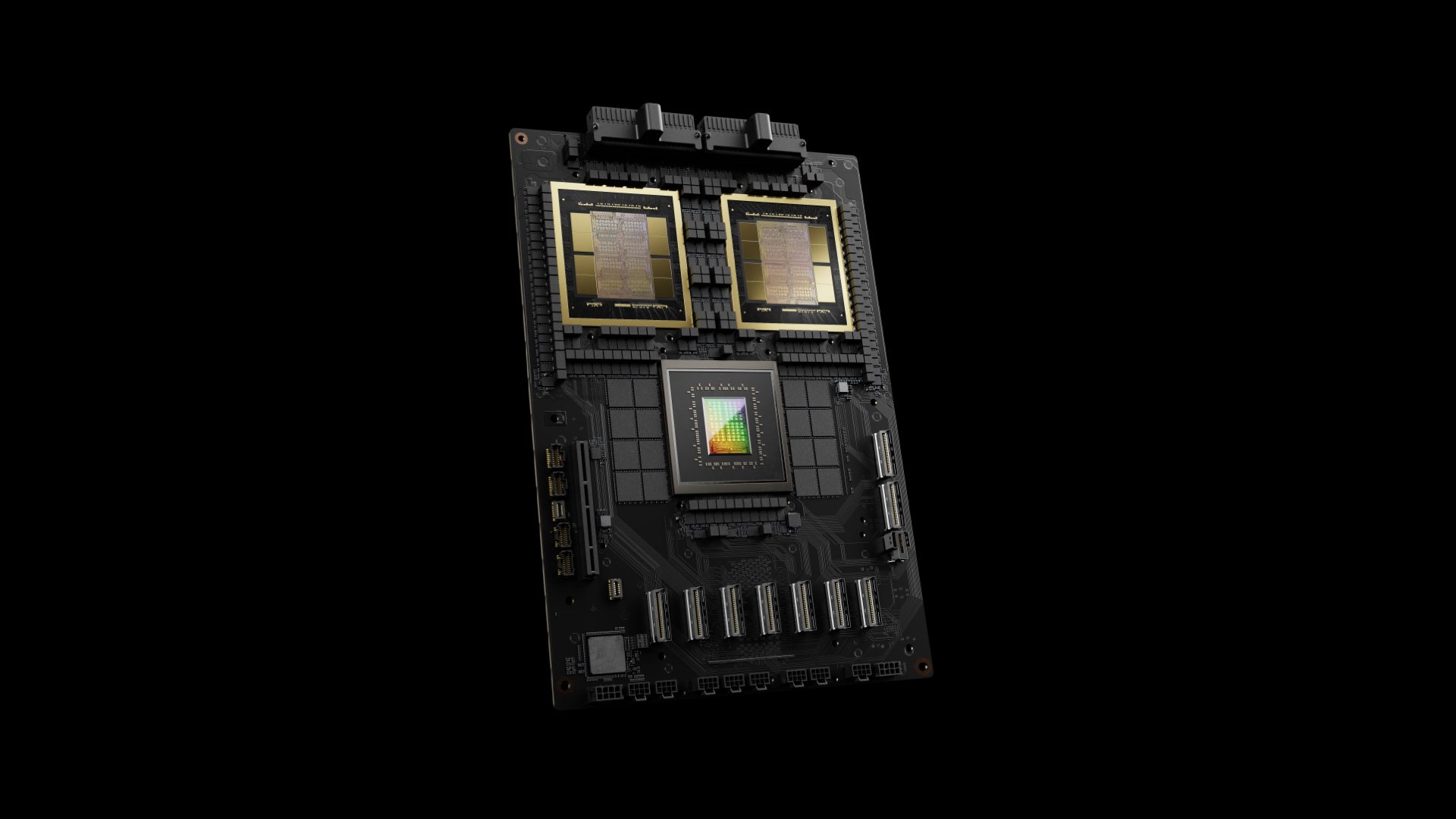

GB200 은 1개의 Grace CPU 와 2개의 B200 으로 이루어진 일종의 보드입니다. 아래와 같이 생겼죠. 그런데 이걸 "Grace Blackwell Superchip" 이라고 부릅니다. Chip 이라는 단어때문에 이게 보드인지 칩인지 계속 혼동되었네요.

nVidia GB200 (Grace Blackwell Superchip)

이걸 NVLink 을 사용해 36개 연결해 총 72 개의 Blackwell GPU 을 내장한게 GB200 NVL72 입니다. NVLink 는 칩과 칩을 연결해주는 고속 인터커넥트 기술입니다.

nVidia GB200 NVL72

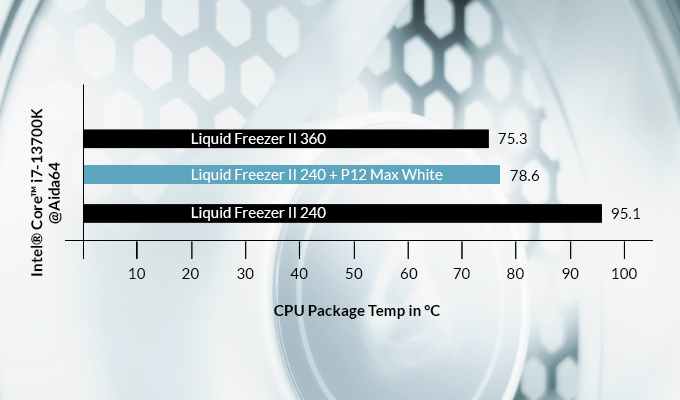

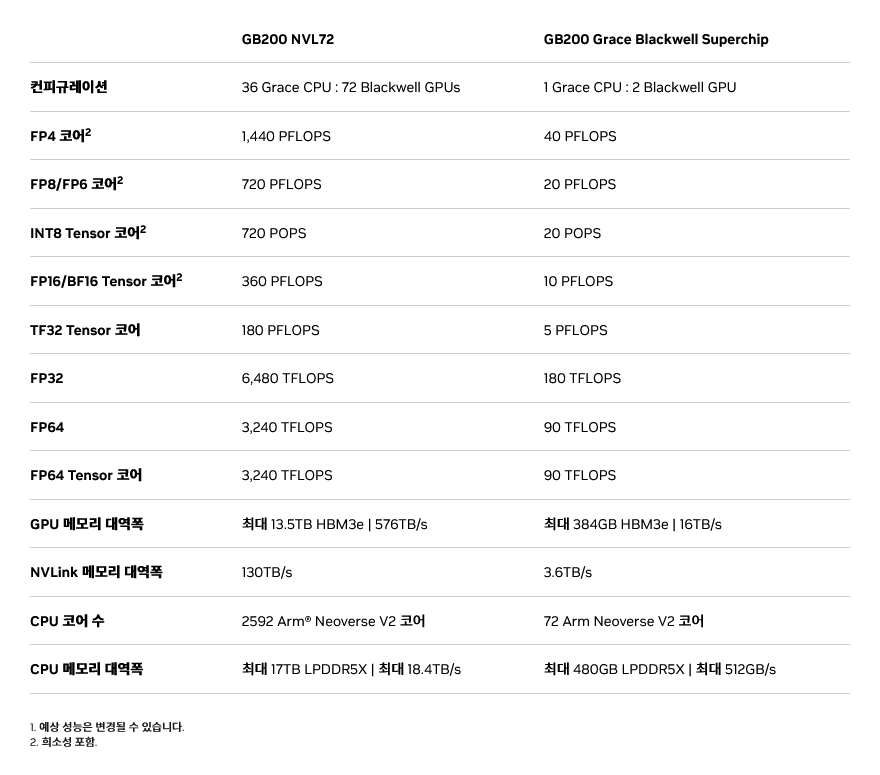

스펙은 아래와 같습니다. FP16 이 360PFLOPS 라는게 인상깊네요. 여기에 그 유명한 HBM3e 가 들어갑니다. 하나 가지고는 싶습니다.

스펙에는 안 나와있지만 GB200 NVL72의 TDP 가 140kW 으로 알려져 있습니다. 보통의 1U 서버 1대의 소비전력이 1kW 정도이고 1Rack(24U) 를 모두 채운다고 해도 24kW 입니다. 2Rack 을 사용하는 GB200 NVL72 라 해도, 소비전력이 140kW 라면 매우 높긴 하네요. 그래도 이전 세대보다 전성비는 좋습니다.