- 글쓴시간

- 분류 기술,IT/스테이블 디퓨전

Wan 2.2 는 중국 알리바바그룹의 통이 연구소에서 개발한 시각모델이다. 2025.07.28에 공개되었다. 주로 동영상을 만들기 위해 사용한다. 오픈소스로 공개되어있다.

기존의 Wan 2.1 의 완성판이다. 이후에는 Wan 2.5 가 나올꺼고, 현재는 WAN 2.5 의 프리뷰버전까지 나왔다. 하지만 이제서야 2.2 를 써 본다.

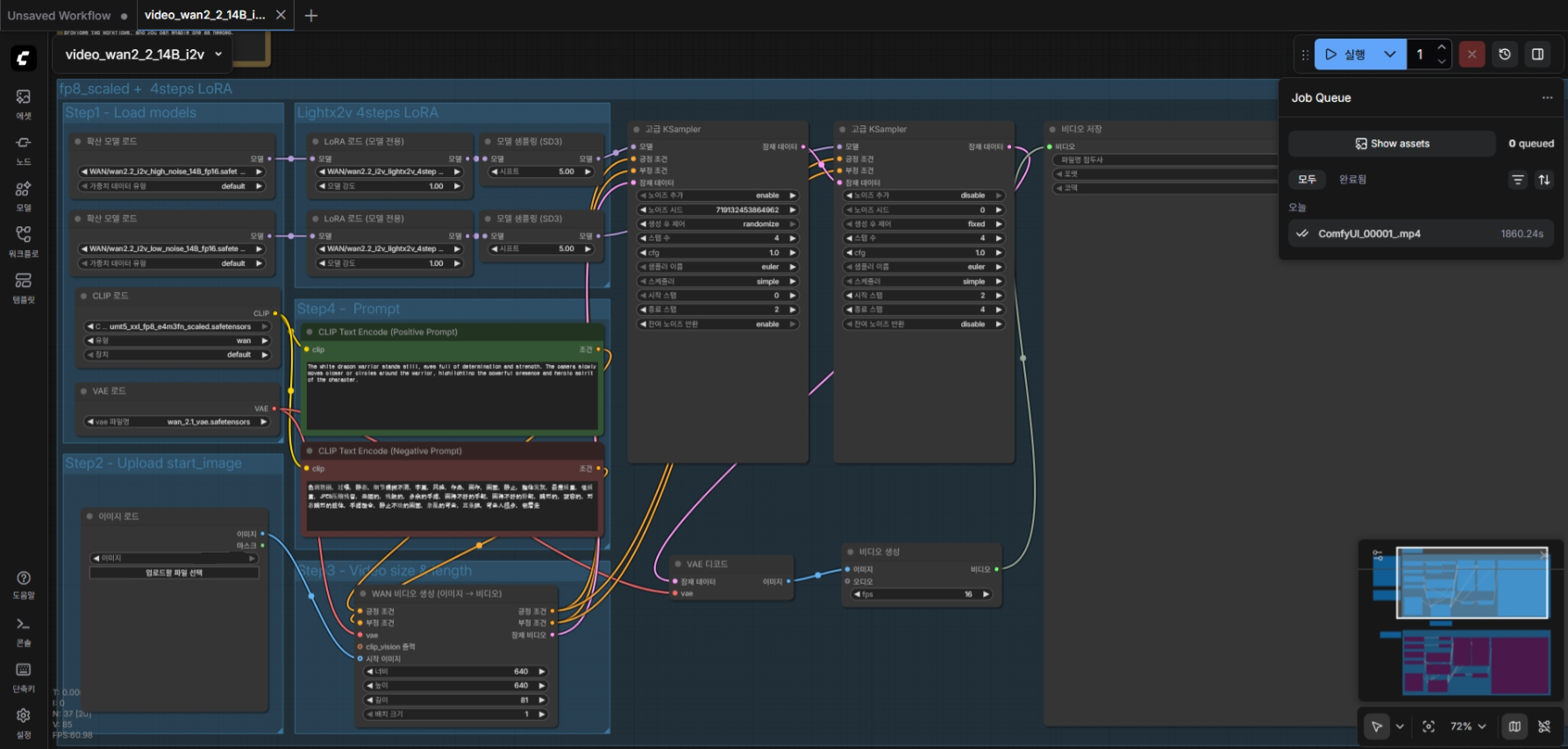

WAN 2.2 의 기본 워크플로. 2060 12G 에서 생성에 30분 걸렸다.

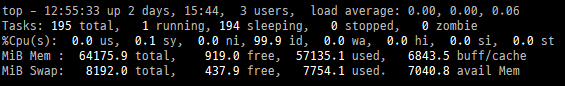

사용방법은 Wan 2.1 과 비슷하다. 모델만 2.2 로 바꿔주면 되는데, Wan 2.2 부터 I2V 에서 High - Low 모델이 분리되었다. High 모델은 구도 잡는데, Low 모델은 디테일을 높이는 데 사용한다. 따라서 동영상을 생성하기 위해서는 모델 2개를 순차적으로 돌려야 한다. 또한 모델 로딩에 필요한 메모리가 2배로 들어간다. 64GB 시스템 메모리에서 간신히 로딩된다. 128GB 는 필요하다. 벌써부터 64GB 메모리가 부족할 줄이야.

ComfyUI 0.4.0 + WAN 2.2 에서 I2V 실행후 남아있는 메모리 사용량. 스왑메모리 사용량을 감안하면 64GB 시스템에서 사실상 모자른 셈이다.

Lightx2v 에서 정제버전을 공개했다. 이를 사용하면 4 스텝으로도 충분한 품질을 얻을 수 있다고 한다. 20 스텝 -> 4 스텝 이니 5배나 빨라진 셈이다. 안쓸 이유가 없고 ComfyUI 문서에도 사용하라고 나온다.

RIFE VFI 프레임 보간을 사용해서 생성할 이미지의 FPS 를 올려주는 방법도 있다고 하는데 아직 적용은 못해봤다.

Wan2.2 Video Generation ComfyUI Official Native Workflow Example - ComfyUI